Chroniques de la Rhubarbe

February 12, 2025 at 10:26 AM

Max Tegmark @tegmark, chercheur au "Future of life Institute":

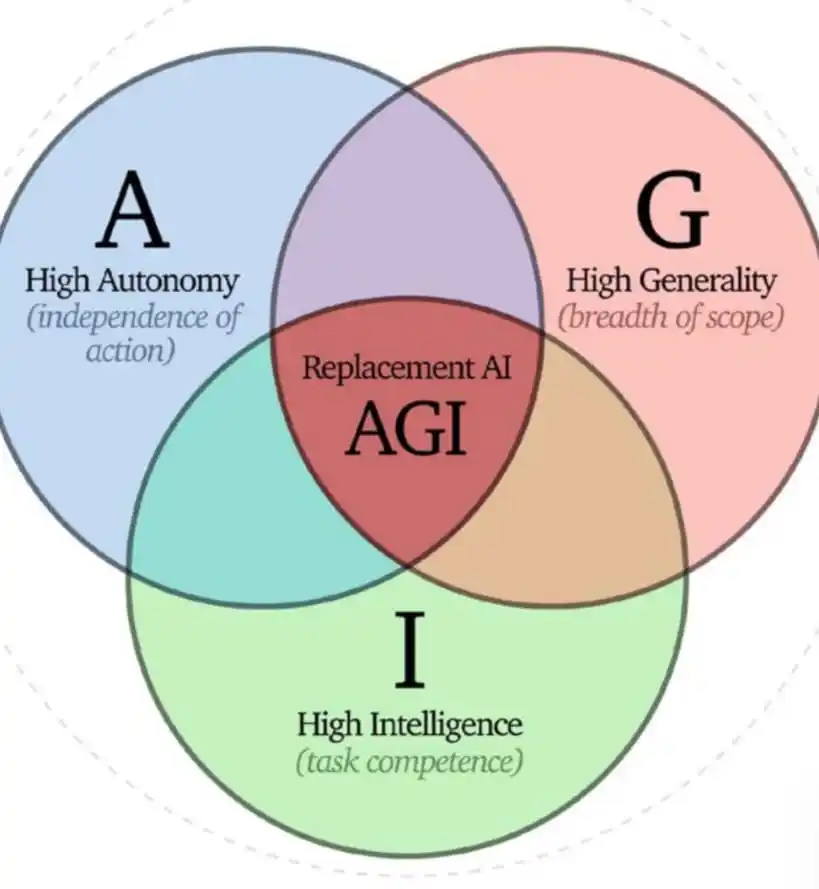

"Presque tous mes interlocuteurs souhaitent une IA outil plutôt qu'une AGI : une IA contrôlable qui nous donne du pouvoir plutôt qu'une IA "dieu numérique" commercialisée à outrance qui nous remplace et que nous ne savons pas comment contrôler. Le point essentiel du diagramme de Venn ci-dessous est que nous pouvons obtenir tous les outils que nous voulons tant que nous ne mettons pas trop de "A", de "G" et de "I" dans le même système. "

"Les outils d'IA contrôlables et bénéfiques que nous voulons sont à notre portée - mais pour les obtenir, nous devons commencer à traiter l'industrie de l'IA comme toutes les autres industries à fort impact, avec des normes de sécurité juridiquement contraignantes qui incitent les entreprises à innover et à donner la priorité à la sécurité publique."

La course à l'AGI est un peu l'équivalent de la recherche en gains de fonctions des virus, origine probable du Sars-CoV-2: on fait le pari que le monstre ne nous échappera pas, et que les bénéfices attendus valent plus (pour ceux qui contrôlent la technologie) que le risque imposé, à leur insu, aux populations.

Le problème de l'AGI, ou de la superintelligence qui en résultera (d'ici 2-5 ans aux dernières nouvelles), est précisément qu'elle sera superintelligente, et que la contrôler serait équivalent à un groupe de singes s'imaginant contrôler un groupe d'humains équipés d'outils qu'ils ne comprennent pas, genre tronçonneuse.

Il semble être dans la nature humaine de faire ce genre de pari, et sans doute dans la nature de toute civilisation technologique. Ça marche jusqu'au jour où ça ne marche plus, et c'est peut-être pourquoi nous ne voyons pas de traces de civilisations avancées dans notre espace visible : elles n'ont pas duré longtemps (hypothèse du Grand Filtre).